【生成AI】Agentic開発をローカルLLMで構築した現状の環境

どうも、だらはです。

今回は、無料で生成AIを使い倒すため、ローカルLLMについて色々試してみましたのでまとめたいと思います。

開発環境の準備

先ずは開発環境の準備です。

基本はVS Code+Continueという拡張機能になります。

VS CodeはMicrosoft Storeから入手し、Continueは拡張機能から「Continue – open-source AI code agent」をインストールしてください。

そうしたら、Ollamaへサインインし環境をインストール&起動します。

起動が完了したら、次はローカルモデルをダウンロードします。

PowerShellをWindowsメニューより起動し、以下を実行してください。

ollama pull gemma4:e4b

ollama pull qwen2.5-coder:7b

ollama pull nomic-embed-textそしたら、Open Settings -> Local Configからconfig.yamlを開き、以下のように記載します。

name: Local Assistant

version: 1.0.0

schema: v1

models:

- name: qwen2.5-coder:7b

provider: ollama

model: qwen2.5-coder:7b

contextLength: 32768 # RTX 4060で快適な最大ライン

#contextLength: 128000 # 最大

roles:

- chat

- edit

- apply

- autocomplete

capabilities:

- tool_use

# QwenのJSONエラー対策:ツール使用の際はフォーマットを厳守するよう示唆

systemMessage: "あなたは優秀なエンジニアです。ツールを使用する際は、指定されたJSONフォーマットを厳密に守ってください。回答は日本語で行ってください。"

- name: gemma4:e4b

provider: ollama

model: gemma4:e4b

contextLength: 32768 # Gemmaのメモリ消費特性を考慮

#contextLength: 128000 # 最大

roles:

- chat

- edit

- apply

capabilities:

- tool_use

systemMessage: "必ず日本語で回答。プロジェクトの全容を把握するため、ツールを積極的に活用してください。"

- name: embeddingsProvider

provider: ollama

model: nomic-embed-text:latest

contextLength: 8192 # モデルの上限値を明示

roles:

- embed

#aya-expanse:8bは削除。ディレクトリ一覧を作ると歯抜けになった

# インデックスは引き続きDisableでOK

disableIndexing: true

context:

- provider: codebase

- provider: docs

- provider: folder

- provider: code

- provider: terminal

- provider: diff

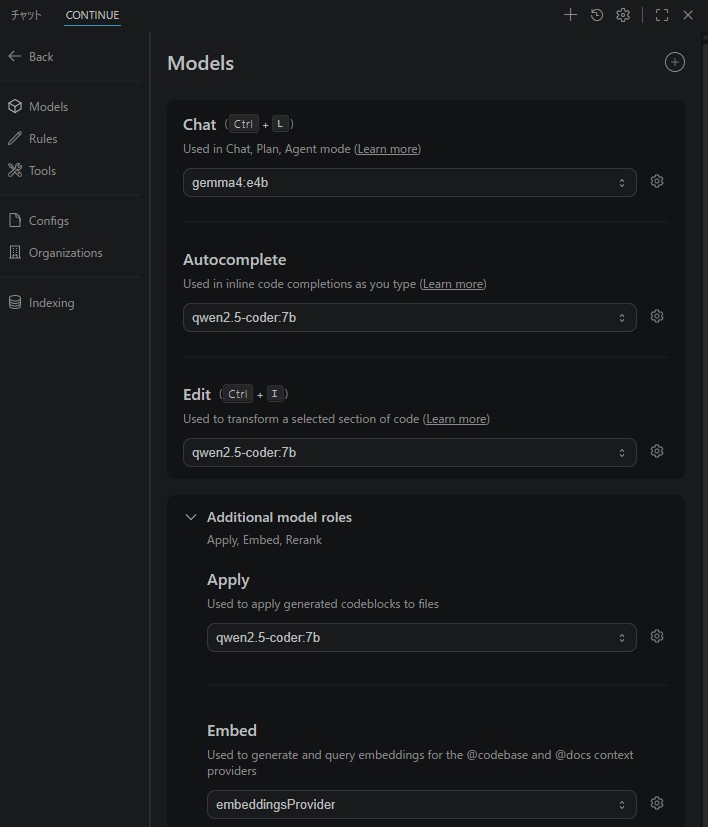

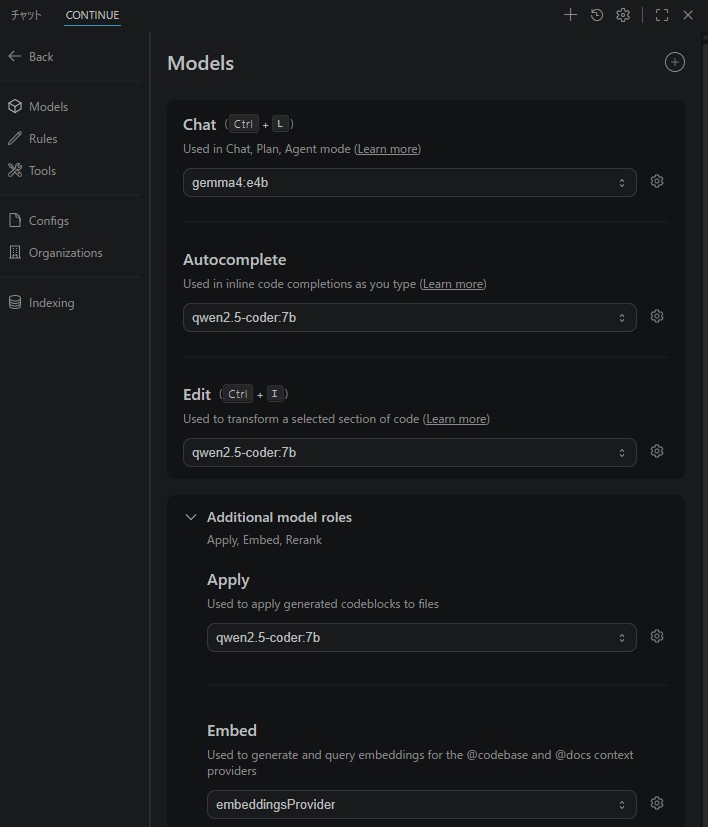

- provider: searchそうすると、Modelsタブより各モデルの役割を選択することができるので、下図のように設定します。

これで完成です!

色々とローカルLLMを試したのですが、

- aya-expanse:8b:ディレクトリ一覧を作ると歯抜けになり、mdを作るにも一苦労なので削除

- llama3.2:latest:日本語が弱い。

- qwen2.5-coder:7b:チャットのAgentモードでJSONを吐き出すエラー。

- gemma4:e4b:一番日本語が流暢でディレクトリ一覧も吐き出せた。

こんな感じで、チャットベースは基本gemma4:e4bが良かったです!

…

……

………

もっと、凄いグラボ入れればよかったー!

といっても、高いグラボを買うより、GithubCopilotChatの有料プランを利用するほうがコスパ良いかもしれないけど。

やっぱGithubCopilotChatめちゃくちゃ便利だし、有料化も視野に入れても良いのではないか、、と欲が尽きないです。

以上、だらはでした。

追記:2026/4/25

私の現在のパソコンのスペックだと、載せられるローカルLLMの回答精度が甘く開発効率が悪いです。

試しに、Claude Codeをフリープランで導入すると、フリープランなのにめちゃくちゃ簡単にUnityゲーム化できちゃいそうです。

PoCでもゲームができたら記事にまとめたいと思います!

ディスカッション

コメント一覧

まだ、コメントがありません